Hi, nah pada pembahasan kedua kita

akan belajar mengenai Bayes Rule atau aturan Bayes. Ada yang sudah tahu perihal

Bayes Rule? Mungkin sebagian sudah familiar mengenai aturan Bayes, mungkin juga

sebagian tahu ilmunya tapi belum tahu bahwa itu disebut sebagai aturan Bayes

(kayak aku hehe), atau mungkin belum tahu sama sekali. Gapapa, kita akan

belajar pelan-pelan terkait aturan Bayes. Mengutip dari Wikipedia, dalam teori

peluang dan statistik teorema Bayes mendeskripsikan peluang suatu kejadian

berdasarkan pengetahuan terkait kondisi sebelumnya yang terkait dengan kejadian

tersebut. Kalau aku pribadi lebih familiar dengan istilah probabilitas

bersyarat dibanding Bayes Rule, tapi secara garis besar sama kok. Mungkin ada

beberapa tambahan teori lain di Bayes Rule. Bingung nggak? Hehe. Jadi biar

nggak bingung langsung aja ke contoh ya, misalkan kita pake kasus yang kemarin

di postingan sebelum ini, ya..

KASUS I

KEJADIAN

|

CUACA

|

SUHU

|

KELEMBAPAN

|

1

|

C

|

S

|

Dr

|

2

|

H

|

S

|

Dr

|

3

|

H

|

D

|

Hu

|

4

|

C

|

P

|

Dr

|

5

|

C

|

P

|

Dr

|

6

|

C

|

P

|

Hu

|

7

|

C

|

S

|

Dr

|

8

|

H

|

D

|

Hu

|

9

|

H

|

D

|

Hu

|

10

|

C

|

P

|

Dr

|

Keterangan:

C : Cerah

H : Hujan

S : Sedang

D : Dingin

P : Panas

Dr : Dry

Hu : Humid

Nah kalau sebelumnya kita kan

menghitung peluang kejadian dalam 1 kelas yang sama, misal peluang kejadian

cuaca cerah dari “himpunan Cuaca” adalah

6/10 atau 0.6. Nah kalau kita menerapkan Bayes Rules artinya kita menentukan

suatu peluang dengan syarat kejadian lain juga terjadi. Misalnya, tentukan

peluang cuaca cerah [P(C)] jika

suhunya sedang (S), jadi peluang

yang dipertimbangkan adalah semua kondisi cuaca cerah dengan syarat suhunya

sedang (S). Umumnya kondisi peluang

seperti ini ditulis [P(C|S)].

Sekarang coba hitung peluang [P(C|S)]

dan bandingkan hasilnya dengan perhitungan berikut.

Caranya adalah:

1.

Cari semua kondisi suhu Sedang (S), kita akan mengetahui terdapat 3 kondisi suhu sedang (kejadian 1, 2,

dan 7)

2.

Cari kondisi suhu sedang dimana cuacanya adalah

Cerah (C), dari sini kita akan

mendapatkan informasi bahwa terdapat 2

kondisi cuaca cerah dengan suhu sedang (kejadian 1 dan 7).

3.

Nah peluang kejadian [P(C|S)] adalah 2/3

4.

Perlu diingat bahwa [P(C|S)] tidak sama

dengan [P(S|C)]. Jadi sifat

komutatif tidak berlaku pada aturan Bayes.

Sekarang coba hitung peluang

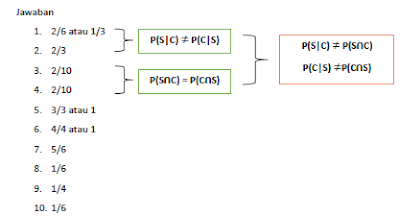

kejadian dari beberapa kasus berikut ini:

1.

[P(S|C)]

2.

[P(C|S)]

3.

[P(SꓵC)]

4.

[P(CꓵS)]

5.

[P(H|D)]

6.

[P(C|P)]

7.

[P(C|Dr)]

8.

[P(H|Dr)]

9.

[P(C|Hu)]

10.

[P(Hu|C)]

Berdasarkan kasus di atas, kita

tahu bahwa kita juga harus memahami perbedaan antara peluang bersyarat [P(S|C)] dan peluang irisan [P(SꓵC)]. Lantas apa yang

membedakan? Hasil perhitungan (jawaban) diatas sebenarnya sudah dapat

menggambarkan perbedaan antara peluang bersyarat dan peluang irisan. Kuncinya

adalah untuk kondisi syarat yang sama, meskipun syaratnya dibolak-balik, nilai

peluang P(SꓵC)

= P(CꓵS).

Sedangkan, nilai peluang pada perhitungan probabilitas bersyarat harus mempertimbangkan

urutan syarat kejadian, sehingga P(S|C)  P(C|S). Sehingga

dapat kita ketahui jika peluang P(SꓵC)

P(C|S). Sehingga

dapat kita ketahui jika peluang P(SꓵC)  P(S|C). Pada kasus peluang irisan,

denominator peluang adalah jumlah data dalam sampel himpunan, sementara

denominator pada perhitungan peluang bersyarat adalah kondisi syarat yang

ditentukan.

P(S|C). Pada kasus peluang irisan,

denominator peluang adalah jumlah data dalam sampel himpunan, sementara

denominator pada perhitungan peluang bersyarat adalah kondisi syarat yang

ditentukan.

Baik kita fokus lagi ke pembahasan

aturan Bayes. Nah secara teoritis, aturan Bayes dapat dituliskan sebagai

berikut:

Dimana,

P(A | B) : Posterior probability

P(B | A) : Likelihood

P(A) : Prior probability

P(B) : Marginal likelihood

Jadi sewaktu kita mendengar

misalnya posterior probability atau prior probability itu kita punya

bayangan posisinya dimana, menjelaskan apa, dan seterusnya. Jadi pemahaman atas

istilah-istilah ini juga penting hehe. Sekarang saya tanya, kenapa sih kalian

harus belajar Bayes? Apa hubungannya dengan pembelajaran JST dengan jenis PNN

dan CPNN? Jadiii, kita perlu memahami aturan Bayes agar kita dapat terbiasa

dengan cara kerja atau konsep peluang. Seperti yang kita tahu, PNN merupakan

singkatan dari Probabilistic Neural

Network, yang artinya pembahasan terkait perhitungan probabilitas adalah

yang paling penting dan algoritma

peluang paling sederhana adalah Bayes. Oleh karena itu, kita perlu memahami

konsep ini dari dasar.

Nah sudah lumayan paham, kan? Baik,

mari dilanjutkan ya! Mungkin sebagian dari kalian bakalan bertanya misalkan nih

kalau syarat kejadiannya lebih dari satu. Nahlo, gimana? Hehe. Kondisi seperti

ini tentu lebih realistis ya, karena kita tahu prediktor kejadian hujan

(misalkan) itu nggak mungkin cuma SATU (1), tentu banyak sekali faktor yang

mempengaruhinya. Iya kan? Jadi bagaimana? Simak penjelasan berikut!

Pada kasus-kasus dimana syarat

kejadian lebih dari satu maka kita harus mengalikan peluang dari

syarat-syaratnya. Karena dalam kasus ini ada dua kelas probabilitas posterior,

yaitu Cerah (C) atau Hujan (H), maka P(A | B) dibagi menjadi 2

untuk syarat prediksi jika suhu X dan kelembapan Y. Misalkan jika suhu X1

= S dan X2 = Hu, maka bagaimana respon yang dihasilkan (Y)? Apakah

hujan (H) atau cerah (C)?

KARENA ADA 2 KELAS OUTPUT, MAKA:

dimana,

P(A

| B) dibagi menjadi 2 kelas, yaitu P(ACERAH | B) dan P(AHUJAN

| B)

P(B

| A) dibagi menjadi 4 karena terdapat 2 kondisi syarat dan 2 kelas output,

yaitu

·

P(S | ACERAH)

·

P(Hu | ACERAH)

·

P(S | AHUJAN)

·

P(Hu | AHUJAN)

Nah kita akan membagi perhitungan ini menjadi dua

tahap (didasarkan jumlah kelas outputnya), yaitu:

1. PELUANG

KONDISI CUACA CERAH DENGAN SYARAT SUHU SEDANG, RH HUMID (X1 = S dan

X2 = Hu)

-

Hitung terlebih dahulu prior probability [P(A)]

P(ACERAH) =

6/10

-

Hitung nilai marginal

likelihood [P(B)] untuk 2

kondisi syarat -> [P(X1 =

S dan X2 = Hu)]. Caranya sama persis dengan penerapan aturan

Bayes sebelumnya, ya ^^

P(S) = 3/10

P(Hu) = 4/10

-

Hitung nilai posterior

probability untuk 2 kondisi syarat -> P(S | ACERAH) dan P(Hu

| ACERAH). Caranya sama persis dengan penerapan aturan Bayes

sebelumnya, ya ^^

P(S | ACERAH)= 2/6

P(Hu | ACERAH)= 1/6

-

Nah sekarang masukkan nilai tersebut dalam

perhitungan, nilai probabilitas untuk 2 kondisi dikalikan (dilambangkan dengan ∏, dibaca

phi)

2. PELUANG

KONDISI CUACA HUJAN DENGAN SYARAT SUHU SEDANG, RH HUMID (X1 = S dan

X2 = Hu)

-

Hitung terlebih dahulu prior probability [P(A)]

P(AHUJAN) =

4/10

-

Hitung nilai marginal

likelihood [P(B)] untuk 2

kondisi syarat -> [P(X1 =

S dan X2 = Hu)]. Caranya sama persis dengan penerapan aturan

Bayes sebelumnya, ya ^^

P(S) = 3/10

P(Hu) = 4/10

-

Hitung nilai posterior

probability untuk 2 kondisi syarat -> P(S | ACERAH) dan P(Hu

| ACERAH). Caranya sama persis dengan penerapan aturan Bayes

sebelumnya, ya ^^

P(S | AHUJAN) = 1/4

P(Hu | AHUJAN) = 3/4

-

Nah sekarang masukkan nilai tersebut dalam

perhitungan, nilai probabilitas untuk 2 kondisi dikalikan (dilambangkan dengan ∏, dibaca

phi)

JADI, dapat diketahui bahwa nilai

probabilitas P(AHUJAN | B) > P(ACERAH | B), artinya

pada saat kondisi suhu Sedang (X1=S) dan kelembapan/RH humid (X2=Hu) maka kondisi

cuaca yang memiliki nilai probabilitas posterior tertinggi adalah cuaca HUJAN

(H) dengan nilai peluang sebesar 0.625. Kondisi tersebut menunjukkan bahwa dengan

kondisi suhu Sedang (X1=S) dan kelembapan/RH humid (X2=Hu) maka kondisi cuacanya diperkirakan akan HUJAN dengan nilai peluang 0.625.

0 komentar:

Posting Komentar